On this page

Taskonomy: Disentangling Task Transfer Learning(2018)

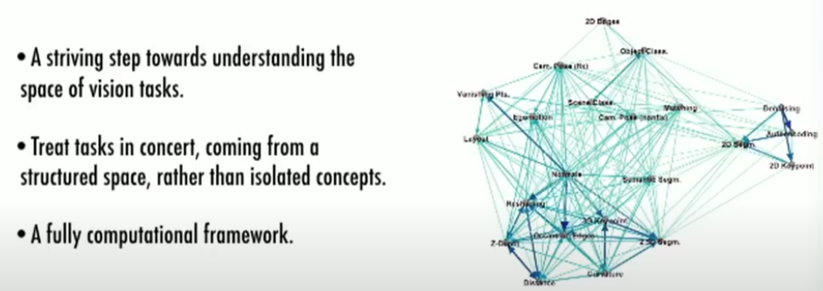

- 비전 태스크간 관계가 있다는 가정하에 Transfer learning을 통해 fully computational framework를 제시

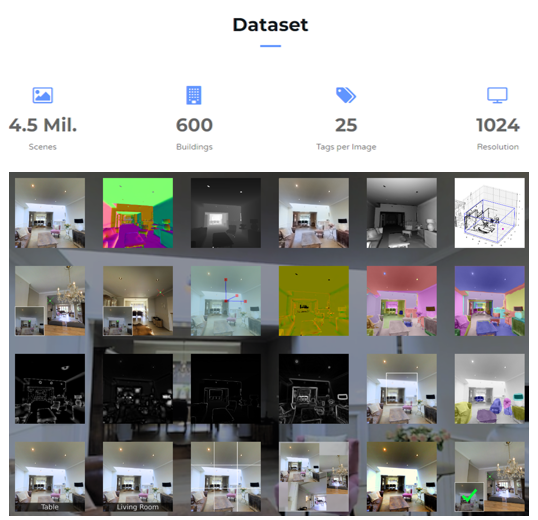

Taskonomy Dataset

Task transfer learning을 위해 설계된 대규모 데이터 셋

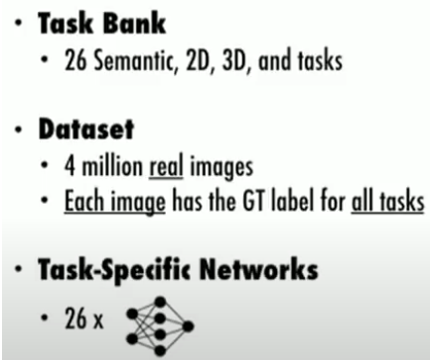

Task: 논문에서는 26

샘플 수: 450만 장

데이터 크기: 11.16TB

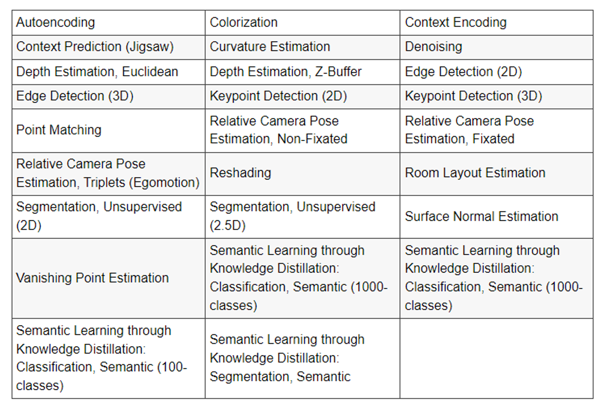

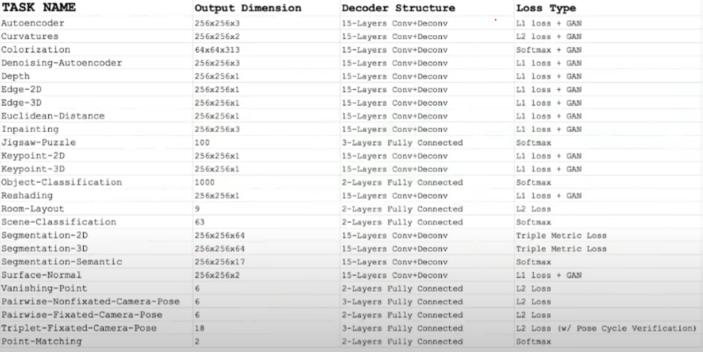

Task

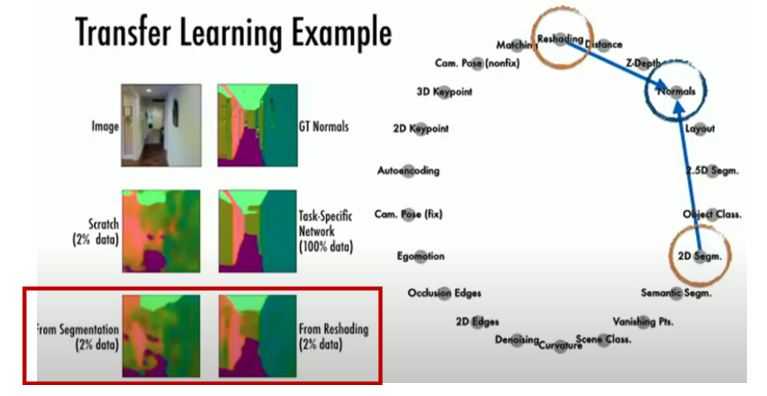

Task example: surface normal

Surface normal task에서 segmentation으로 pretrained된 모델은 잘 예측하지 못하지만,

Reshading으로 pretrained된 모델은 잘 예측하는 모습

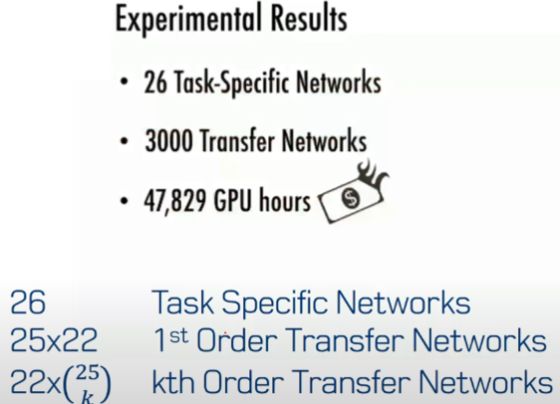

- 26개의 개별 Task-specific networks를 사용

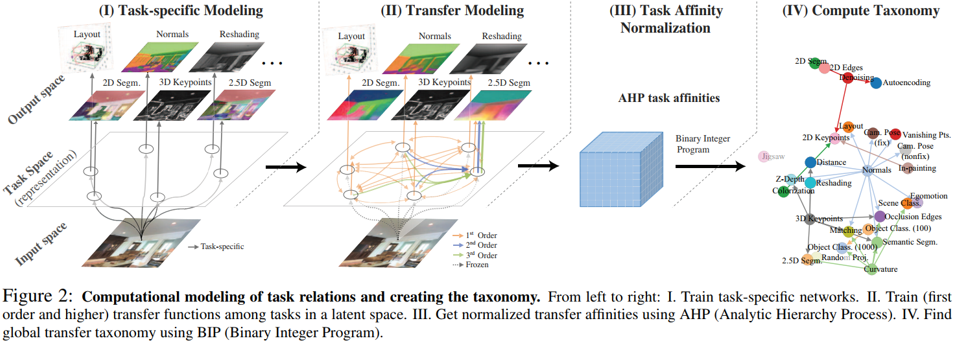

진행 과정

Task-Specific Modeling

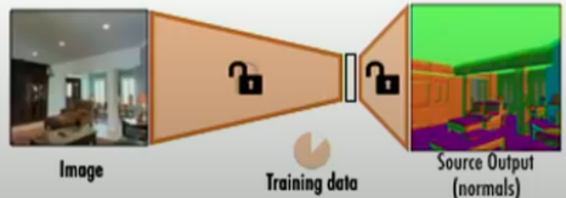

각각의 task에 대해 학습을 시킴

인코더, 디코더로 구성된 모습

자물쇠가 열려있는 것은 가중치 업데이트를 한다는 의미

각 태스크 별 사용된 Output dimension, decoder structure, loss type …

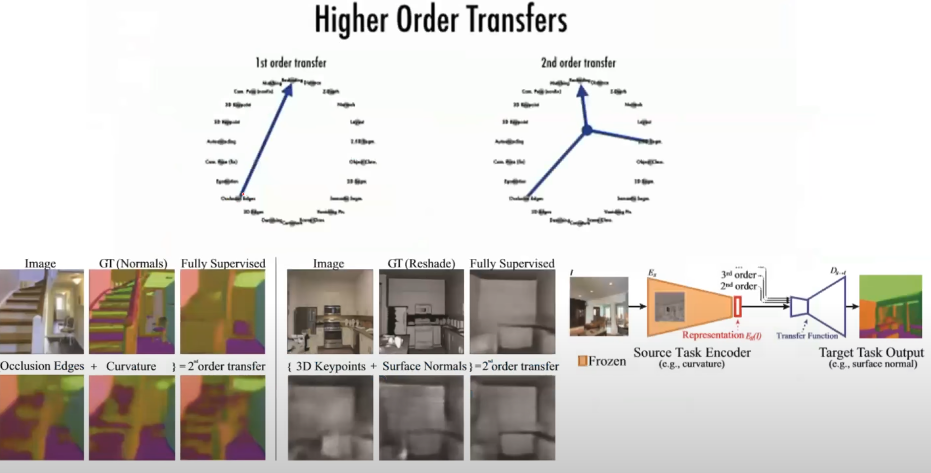

Transfer Modeling

다른 task의 model을 가져와 transfer learning

인코더는 hold. (pretrain 된 걸 사용하고) 작은 capacity를 가지는 디코더를 2%의 데이터로 학습시킴

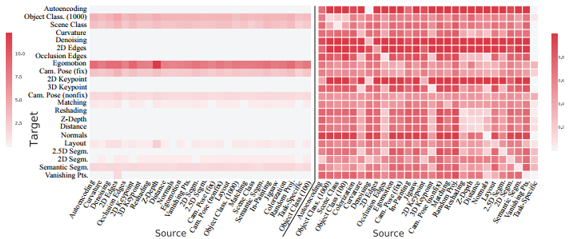

Normalization (AHP)

AHP: Analytic Hierarchy Process 사용, 평가지표가 모두 다르기에 Normalize.

타겟이 있고 26개의 소스가 있는데 각 타겟마다 소스끼리 경쟁을 시켜서 비교를 통해 합이 1이되는 상대적인 weight를 구하고, weight에 맞게 normalize

높을수록(빨강일수록) 안좋다고 한다.

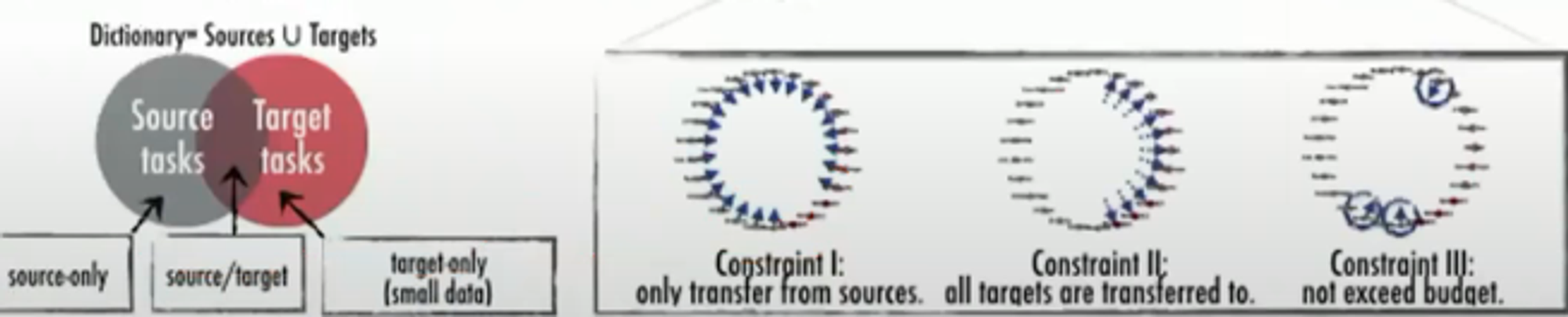

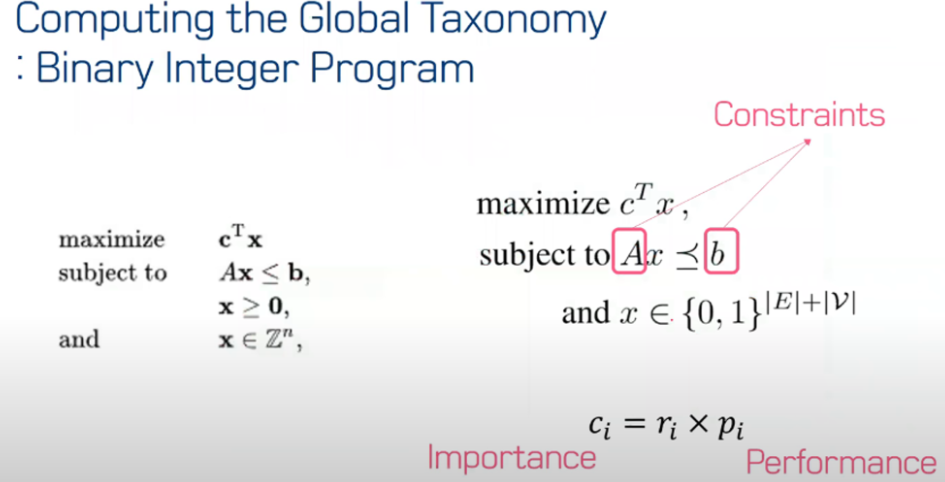

Taxonomy Extraction (BIP)

BIP: Binary integer program을 사용하여 extraction

왼쪽처럼 나타내면 너무 복잡하므로 오른쪽처럼 extraction

소스가 되는 태스크는 그 태스크가 타겟일 때 소스로 가지는 태스크들도 전부 딸려온다. (서브 그래프를 가져온다.)

2번이상 거치지 않는다.

전체 라벨의 수가 제한되어 있다.

이러한 3가지 조건 하에서 fully connected graph에서 sub graph를 고르는 최적화 문제

수식으로는 다음과 같다

\(p_i\) : normalize 된 매트릭스에서의 값

\(r_i\) : 태스크 별로 더 중요하게 여기는 태스크가 있을 수 있으니 그걸 사용자가 파라메터로 조정

Experimental Result

Summary

비전 태스크가 너무 많은데 각자 연구를 하고있다.

transfer learning 같은걸 이용해서 fully computational framework를 제시